この画像を大きなサイズで見る

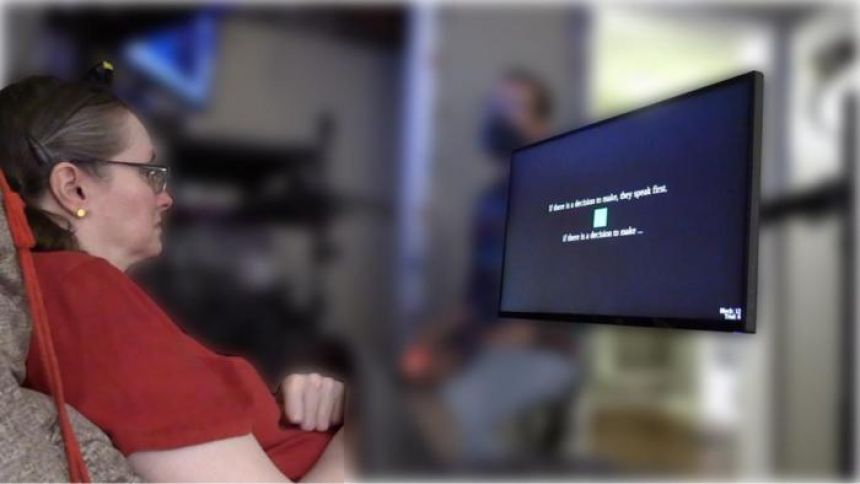

この画像を大きなサイズで見る人が心の中で思う「言葉」、内なる声を、科学者たちがリアルタイムで解読することに成功した。

「ブレイン・コンピューター・インターフェース(BCI)」と呼ばれる技術を使い、脳の活動を読み取ることで、心の中で思った言葉を最大74%の精度で識別することに成功したという。

これは、話すことができない人々にとって、思考そのものを言葉に変換する新たなコミュニケーション手段となる可能性を秘めている。

さらに、パスワードのように、ユーザーが心の中で特定のフレーズを思い浮かべたときだけシステムが起動するしくみも導入されており、すべての思考が読み取られないよう、自分の意思で制御できるという。

この研究成果は学術誌『Cell』(2025年8月14日付)で発表された。

心の中で思った言葉が伝わる技術

今回の成果は、アメリカ・スタンフォード大学の研究チームによって発表された。

研究の中心にあるのが「ブレイン・コンピューター・インターフェース(BCI)」という技術である。

これは、脳内の神経信号をコンピューターに接続して読み取り、意志や思考を外部に伝えるという仕組みだ。日本では「ブレイン・マシン・インターフェース(BMI)」という名称も使われている。

これまでBCIは、たとえば義手を動かしたり、視線で画面操作をしたりといった用途で活用されてきた。

さらに最近では、「話そうとする」口の動きを読み取り、言葉として再現する技術にも応用されている。

しかし、筋肉の制御が困難な人にとっては、「話そうとする」動作すらも大きな負担になることがある。

そこで注目されたのが、声に出さず、頭の中で言葉を思う「内言(ないげん)」だ。動きも発声も必要としないため、思考だけで伝える手段として期待が寄せられている。

この画像を大きなサイズで見る

この画像を大きなサイズで見る最大74%の精度で心の声を読み取ることに成功

研究に参加したのは、筋萎縮性側索硬化症(ALS)や脳幹卒中によって重度の麻痺を抱える4人の患者たちである。

彼らの脳の運動皮質(大脳皮質の一部で随意運動の指令を出す領域)にマイクロ電極を埋め込み、神経活動を記録した。

実験では、参加者に以下の2通りの指示が与えられた。

- 指定された単語を声に出そうと努力する(実際には発声しない)

- 同じ単語を、声にも出さず、心の中だけで思う(内言)

結果として、どちらの行動でも脳の同じ領域が活動し、似たパターンの神経信号が観測された。

ただし、内言の方が全体的に信号の強度は弱く、詳細な分析によって両者の違いも見分けられることが分かった。

次に、この内言の脳信号データをAIに学習させたところ、最大12万5000語の語彙の中から、心の中で想像した言葉や文章を最大74%の精度で正確に解読することに成功した。

さらに驚くべきことに、研究チームは、参加者が指示されていない言葉までもBCIが読み取っていたことを報告している。

たとえば、画面上に表示されたピンク色の円を数える課題では、参加者が心の中で数を数えていたことが検出されたという。

この画像を大きなサイズで見る

この画像を大きなサイズで見る勝手に思考が読まれないためのパスワードを設定可能

思考を読み取る技術が進化すればするほど、気になるのはプライバシーの問題である。BCIが常に内言を解読していたら、本人の意思に関係なく心の中が筒抜けになってしまう恐れがある。

こうした不安を解消するために、研究チームは「起動フレーズ」という仕組みを導入した。

これは、心の中である特定のフレーズを思い浮かべたときだけ、BCIが「内言を読み取ってよい」という合図として認識し、解読を開始するもので、パスワードのようなものだ。

実験では「chitty chitty bang bang(日本語でいうところのチキチキ・バンバン)」という特徴的なフレーズが使われ、98%以上の精度でBCIがこれを認識し、思考の解読をオンにすることができた。

このように、思考の読み取りはあくまでユーザーの意思でコントロールできるように設計されており、倫理的な問題もクリアできるという。

この画像を大きなサイズで見る

この画像を大きなサイズで見る話すことができない人の言葉が届く時代へ

現段階では、BCIが完全に自由な思考や複雑な内言を誤りなく読み取ることは難しい。しかし今回の研究は、「考えるだけで伝える」未来に向けた強い可能性を示した。

今後、センサーの精度やAIの解読能力がさらに進化すれば、BCIは言語を発さなくても他者と意思を交わせる、新しいコミュニケーションの形となるかもしれない。

研究を率いたスタンフォード大学のフランク・ウィレット博士はこう語る。

「BCIの未来は明るい。今回の成果は、思考だけで自然な会話を可能にするという夢を、現実に近づけるものです」

ただしこの技術が悪用されると、SF映画にあるような情報漏洩や尋問などにつながってしまう懸念もある。

この技術を本当に必要としている人たちのために、安全に、慎重に使われていくことが求められる。

References: Brain-computer interface could decode inner speech in real time

(ファミチキください)

発音発語が難しい人にとってはありがたい技術に見えるが

言わなくていいことまで出て来るのは困るだろうに

この研究は進んでほしい!

個人の尊厳との両立が前提ではあるけど、

「活動したい意思」があれば

後は技術でサポートできるといいよね。

心の中で数えている数が認識できるなら、ペットの考えていることも分かるようになるのかな

浮気を疑ってこれで調べる人が続出しそう

話せない人たち同士が学問について熱く語り合える日も近いですね。

(こいつ、直接脳内を…!?)

般化には電極埋め込んでから、チューニングがいるだろう

おそらく朗読を聞かせ、次に朗読させて微調整

人工内耳や眼鏡の調整と同じ手順で

で近未来には遺伝治療で障害を防止、胎児期の形成不全には移殖用オルガノイド

範囲が広く移植が難しい(頭部だし)ならテレパス訓練

こうして人為的ロビン・ウェンズバリーが生まれるのだ

パスワードがあっても話してる途中で人って脱線して色んなこと考えるので

お腹が空いたとかあの人素敵とか

お腹が痛いう〇こ行きたいと咄嗟に思ったことも漏れてしまうのかと思うとちょっとこわい

一番怖いのは、反射的にこの人うざいなとか臭いなとか思ってしまったことが伝わってしまうことかもしれない

政治家が間違いなく規制する

>「チチチバンバン(chitty chitty bang bang)」という特徴的なフレーズ

和訳は、一般的に「チキチキ・バンバン」だと思う。

ていうか、やべぇ、結構イヤーワーム度が高めの主題歌で、文字を見ただけで脳内ループしてるんだが、

言語の読み取りの際に思考浸食されないんだろうか? 慣れれば大丈夫なのか?

これが普遍的な技術と化したり悪用されるとサトラレのような事態になりそうな気がする。

いわゆる天才の人とか瞬間記憶の人の脳内発言どんなことになってるのか非常に気になる。

王ぅ~さまの耳は ロバの耳ぃ~~♪

スマートグラスやVRで活用したら便利になりそう。

独裁国家や犯罪組織が悪用すると誘拐や粛清、洗脳と大変なことになりそうだが。

容疑者の取り調べなんかに使うのはやっぱりマズイかな

普通の人、健常者が付けることを考えるより

やはり喋れないとか動けないとか、あるいは脳死判定されてるけど意識がある(閉じ込められ症候群だっけ?)そういうケースのために使いたい

ヘレンケラーは話せたし、ジョニーは戦場でモールスを覚えて帰って来たけど、意思表示はとても重要(なおいまなら彼女らに骨伝導で聞かすことも出来るかも)

発声に難があれば音声が出るデバイスを持ち歩く

寝たきりでも状態、尿意、感謝や愛の言葉を発信出来る

本人と周囲が楽になる

ペインコントロールがしやすくなるから罵倒や憎悪、自死を望むことも減る

照明、ベットの角度、ナースコール、一部の投薬もそう

入力が無いのでロボの遠隔操作は意味がないが、これもいずれ

>あるいは脳死判定されてるけど意識がある(閉じ込められ症候群だっけ?)ケース

脳死と閉じ込め症候群は、全くの別物。

閉じ込め症候群は、脳幹の一部(橋腹側部)に損傷があって体が動かせないだけで(ただ、眼球や瞼だけは動かせる人が多い)、大脳の脳波を測定すれば正常な覚醒レベルが観測できる。

それとも、「脳死判定されているけど、実際にはそうではなく、単に閉じ込め症候群なのを誤診したケース」の救済判別に使えたら、という話? 脳死判断の正確性に疑問を抱く意見も無くはないけど、少なくとも閉じ込め症候群くらい明らかに覚醒水準の脳波が出ていて、機械を通せば会話が可能になり得るくらいの思考活動がある(=脳幹の一部どころか大脳も無事)なら、まず脳死判定しようという段階にすら至らないと思う。

閉じ込め症候群との判別が難しいのは、むしろ植物状態(=昏睡とちがい目を開いたり覚醒や反射はするが意識が無い)だと思う。

閉じ込め症候群〜植物状態に使いたいわけだが、定義がよくわかっていなかった

そこはすまない

診断するとかじゃなくて、その状態の彼らから何か引き出すことが出来るなら素晴らしいと思うだけ

残った皮膚や鼻、口内への刺激(あったとして)とこれで会話ができるかも

要求や希望にイエス・ノーが伝わるならできる

もし自我や知性が傷ついていても、それも治療や未来の医療に役立つだろう

脳波は脳死状態なのに実際には意識がちゃんとあるケースの症例のことでは?

これ、意思表示が全くできない人の場合、思ってもいないことを言ったことにされてもわかんないよね。確かめようがない。

普通の人が使うのは、いわゆる脳波コントロールか

走る・曲がる・止まるが考えるだけで可能、車でも車いす、シルバーカーでも

カメラとゴーグル組み合わせればドローン撮影を容易に(姿勢制御は別)

乗り物でもGPSとルート検索に+して

「そこ曲がって」(町並みが見たい)

「あのコンビニ寄りたい」とか想定コース修正が楽にも

友人の姉が重度の脳性麻痺で赤ちゃんの頃から施設に入っている

両親は目の動きや吐息である程度言いたい事が分かるそうだが、友人は交流の機会を殆ど設けられずに育ったのでさっぱり分からず、虚しさと申し訳なさと両親が衰えた後の不安ばかりが募るという

早く実用化されて家族で話に花を咲かせる日が来れば良いな

誰かと内言で会話中に、違うことが同時に浮かんだりしたら上手くいかなかったりするのかな?

人って喋ってる間に次に喋る事を整理して考えながら喋ってるじゃない?一度にいくつかの事を同時進行で考える人には向かないのかな?

機械が何かしらの不都合な解釈違いをした場合

口語でのコミュニケーションより致命的な問題が起きそう

頭の中が騒がしい人々の場合はどうなるんだろう??という純粋な疑問

騒がしい脳内全て言語化されるのかな

ATフィールドをこじ開ける技術と化さないか不安

強者によって弱者に強制されたりって流れに発展してったら怖いよ