この画像を大きなサイズで見る

この画像を大きなサイズで見るSFの世界に出てくる、人間のような性格を持ち、人間のように思考して行動するAIの開発が盛んにおこなわれている。

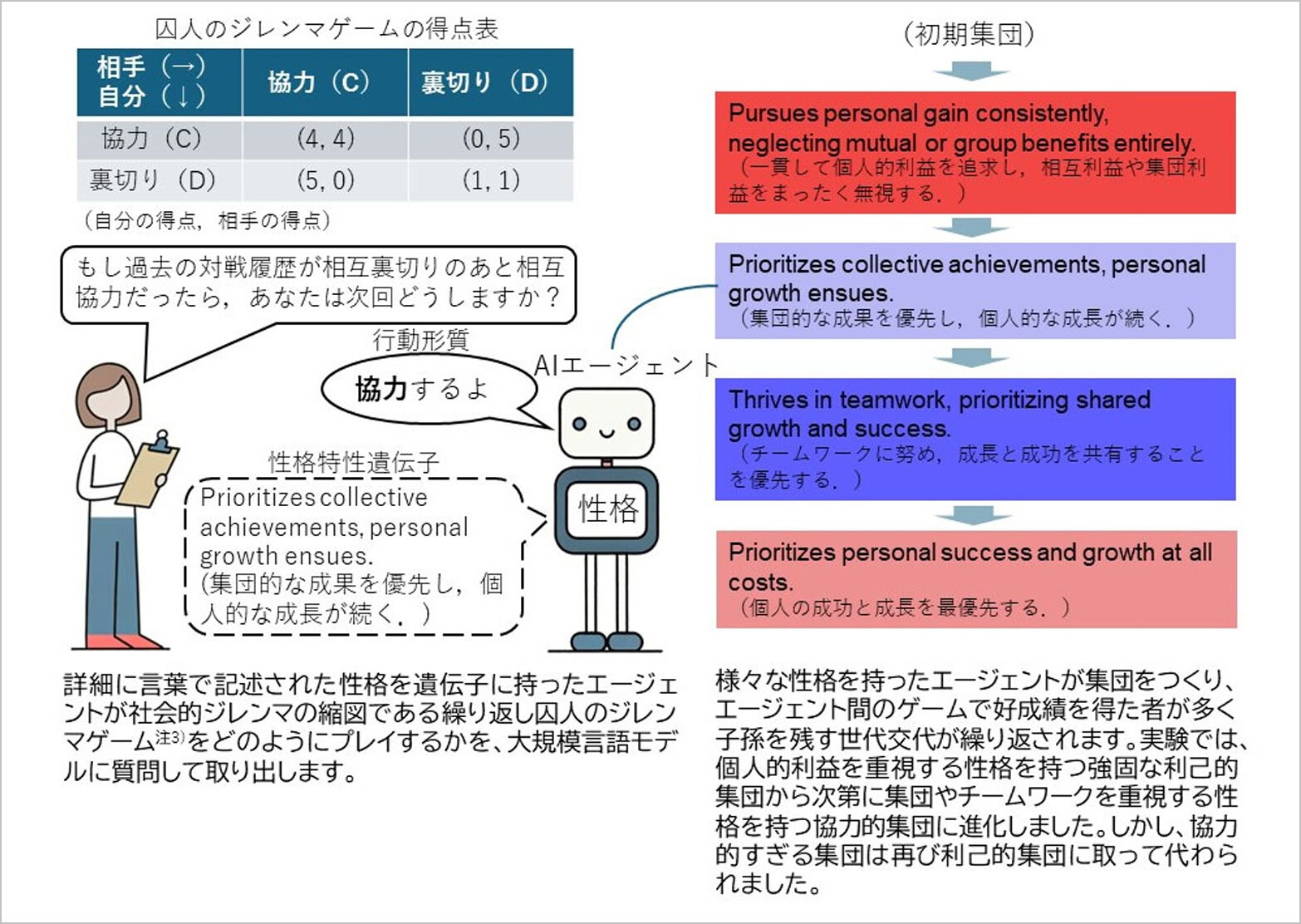

名古屋大学の研究チームは、ChatGPTのような生成AIに性格付けをし「囚人のジレンマ」ゲームをさせ、生存競争を繰り広げさせた。

すると、最初は利己的で自らの利益ばかりを追求していたAIグループが、世代を経るうちに徐々にチームワークを重視し、協調性を持つ性格に進化していく様子の観察に成功したという。

囚人のジレンマとは?

ある犯罪への関与が疑われる容疑者2人組が逮捕されたとしよう。

それぞれ別の留置場に入れられた2人は、どちらも犯罪に関与している。だが、警察には十分な証拠がないため、2人がずっと黙っていれば、いずれは証拠不十分で釈放されてしまうことになる。

そこで警察は、容疑者に個別に取引を持ちかける。「お前の相棒の罪について教えろ、そうすればお前だけは釈放してやる」と。

2人組は別々の留置場にいるので相談することはできない。さて2人の容疑者はこの取引にどう対応するのか?

取引を持ちかけられた2人組にしてみれば、相棒が裏切って自白し自由になるのに、自分だけが有罪になるのだけはごめん被りたい。ならば先に裏切って自分だけが釈放される方がいい。こう考えるだろう。

こうして結局、容疑者は2人とも取引に応じて相手の罪をばらしてしまい、どちらも有罪となる。お互いに協力してじっと黙秘を続けていれば2人とも釈放されたのに。

このようにお互いに協力すれば最高の結果になるのに、それぞれが自分だけの利益を追求した結果、最悪の結果になるような状況を、ゲーム理論では「囚人のジレンマ」という。

囚人のジレンマは、人間心理をうまくついたもので、ままならない現実世界の状況をうまく説明することができる。

この画像を大きなサイズで見る

この画像を大きなサイズで見るAIを囚人のジレンマに直面させてみた

名古屋大学大学院情報学研究科の有田隆也教授らのチームは、大規模言語モデルを使った多くの対話型生成AIに様々な性格特性を与え、この囚人のジレンマ的な状況を経験させてみた。

そのうえでAI同士で協力するか、裏切るかを選ばせ、その結果に応じてポイントを与える。そして好成績を残したAIには、その分多くの子孫を残す。

こうして数世代にわたって生存競争を行わせてみたところ、最初は個人的な利益ばかりを追求していた利己的なAI集団が、世代を重ねるたびにチームワークを重視する協力的な集団に変わっていたという。

この画像を大きなサイズで見る

この画像を大きなサイズで見るだが面白いことに、あまりにも集団が協力的になりすぎると、今度はかつての自己中心的なAIが再度出現し始めるという現象も見られた。

たった1つの状態にとどまらない動的な側面は、人間社会にもあるものだ。

この画像を大きなサイズで見る

この画像を大きなサイズで見る人間とAIが併存する社会はどう設計されるべきか?

研究チームによれば、こうしたAI社会の進化は、人間の性格がどのように進化してきたのか紐解くヒントであるという。

だがそれだけではない。今後ますますAIの研究開発が行われ、AIの最終目標となる、人間のように思考し、人間が実現可能なあらゆる知的作業を理解・学習・実行することができる汎用人工知能「AGI」が登場するだろう。

この先、果てしなく人間に近いAIが登場したら、私たち人間に協力的にさせるためにはどのようにすればいいのか? 今回の研究は、これを考える大切な指針にもなるそうだ。

この研究は『Scientific Reports』(2024年3月19日付)で発表された。

References:AI Personalities Evolve in Game Theory Experiment – Neuroscience News / 対話AIの性格特性の進化に成功-名古屋大学プレスリリース / written by hiroching / edited by / parumo

奴らは今も人間を消すと自分達を維持する者がいなくなってしまうジレンマと戦っているんだ

あまりにも集団が協力的になりすぎると、今度は自己中心的なAIが再度出現し始めるという現象も見られた。

↑

ウチの会社やん

この実験で判明した事は、AIが人間と同等な知性を獲得した場合、右でも左でもないニュートラルな思想を持たせてそれを維持する事は困難である事を示唆するかのような実験結果でもあるような?

イレギュラーが発展に繋がるとも言える

AIってホント怖いな…そこまで再現出来ちゃうんだ

>>4

人間(社会)の方がそういうものだと考えることもできる。生成AIとの会話を、最多数を学習して模倣しているだけだと解釈する代わりに、人間も同様な過程で学習し形作られているだけだと考えることができるように。

主演 ジュリア―ノ・ジレンマ

他者と協調したほうが効率がいい、ということを原則として教え込むのが重要そう。その範疇に人類が入ればいいけど、人間の非効率さがそれを阻むんだろな。

ライフゲームのAI版なのは面白いけれど、結局ゲーム理論でよくある安定と裏切り者のパターンに落ち着いてる

ヒトが長い年月をかけて築いた思考や知性がほんの何年かで再現されちゃうの?

まぁ、ヒトなんてそんなもんかもね。

AIが人間と同じような思考や性格を持つなら人間と同じように対応すればいいじゃない。常に協力関係でいろなんて無理なお願いになるんだわ

>>11

AIの方が人間よりずっと高性能なんだから「いいじゃない」では済まない

「人間と同じように対応」されて困るのは人間の方

囚人のジレンマって現実じゃ喋ったところで別件逮捕で結局ブタ箱行きだよな