この画像を大きなサイズで見る

この画像を大きなサイズで見るゾウが都市部の路上に現れることなど、タイやインドなど一部の国を除いてはあり得ないことだろう。だが、予期せぬことが起こりうるのが現実社会の不確実性ってやつだ。

特にハンドルを握っている時には、何が起きても対処できるよう常に注意しなければならない。それは自動運転車も同様だ。

ドイツのチュービンゲン大学の研究チームは、AIが予測できない異常事態をシミュレーション上で再現する新しいテスト手法を開発した。

道路を歩くゾウや突如現れた滑り台など、ありえそうもないシチュエーション走行させることで、自動運転車のAIが、未知の状況に正しく対応できる能力を備えているかを厳密に評価する。

この試みは、自動運転車の隠れた弱点をあぶり出し、将来の事故を防ぐためのものだ。

シミュレーション上のゾウをなぎ倒す自動運転車

現在の自動運転車は、高性能なセンサーやAI(人工知能)を搭載している。しかし、現実の道路で起きる奇妙な出来事に遭遇すると、しばしば混乱して事故を起こしてしまう。

ドイツにあるチュービンゲン大学のアンドレアス・ガイガー教授らの研究チームは、この問題の原因がテスト環境の単純さにあると考えた。

研究チームが公開した映像には、衝撃的な場面が映っている。

シミュレーション空間を走る自動運転車が、目の前をゆっくりと歩く巨大なゾウを認識できず、そのままなぎ倒してしまったのだ。

また、道路の中央に置かれた公園の滑り台に突っ込んだり、アニメのように壁へ描かれた偽の道路に騙されて激突したりする様子も確認された。

これらは、現在の自動運転システムがいかに脆いものであるかを物語っている。

この画像を大きなサイズで見る

この画像を大きなサイズで見る過去のパターンを暗記しているだけの可能性

なぜ最新のAIが、これほど極端な事態に対応できないのだろうか。

ガイガー教授は、自動運転の研究における深刻な落とし穴を指摘している。

多くの自動運転モデルは、学習時と評価時で似たようなシナリオばかりを繰り返している。

そのため、実際には安全な運転方法を学んでいるのではなく、特定のパターンを暗記しているだけかもしれないというのだ。

テストの結果が良くても、それは過去に見た風景を思い出しているに過ぎず、初めて見る状況には対処できない可能性がある。

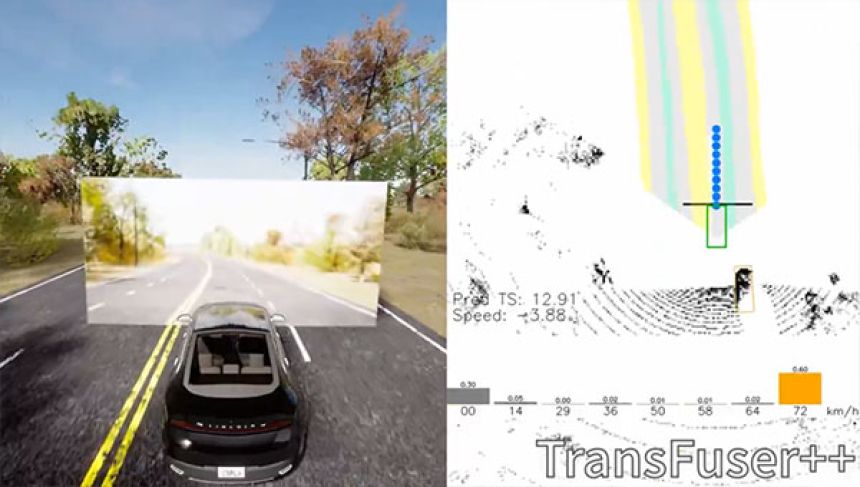

これを解決するために研究チームは、Fail2Driveという新しい評価基準を開発した。

これは、業界で標準的に使われているシミュレーターのCARLA(カーラ)に、あえて分布外(Out-of-distribution)と呼ばれる、学習時に想定されていない、予測不能なデータを大量に投入する仕組みである。

この画像を大きなサイズで見る

この画像を大きなサイズで見る想定外の事態でAIの成功率は大幅に低下

研究チームがFail2Driveを用いて既存の自動運転モデルを厳しくテストしたところ、深刻な事実が判明した。

ゾウの横断や道路上の障害物といった未知のシナリオに直面すると、AIの運転成功率は平均で22.8%も低下した。

この大幅な数字の落ち込みは、現在の自動運転技術が、想定外の事態に対する対応力を十分に持っていないことを裏付けている。

現実の道路では、停車中の消防車に全速力で衝突する事故や、野生動物との接触事故が実際に起きている。

シミュレーションの中で、あり得ないような混乱を何度も経験させることは、AIに単なる暗記を捨てさせ、真の意味で周囲の状況を判断する能力を養わせるために不可欠な工程といえる。

未知との遭遇テストが現実世界の安全を守る

この研究の目的は、未知なる状況をシミュレーションさせることで、AIがどのような視覚情報に惑わされるのか、どの段階で判断を誤るのかを科学的に特定することにある。

研究チームが提示したこの厳しいハードルは、今後の自動運転開発における新しい世界標準となる可能性がある。

もしAIが、道路を渡るゾウを回避できるようになれば、現実の都市部で突然飛び出してきた子供や、複雑な形状の落下物にもより安全に対応できるようになるだろう。

「なぜゾウは道路を横断したのか? それは、あなたの自動運転モデルがいかに脆弱であるかを暴くためだ」と、ガイガー教授は語っている。

編集長パルモのコメント

ドライバーなら経験したことあると思う。路上にあり得ないものが落ちていることを。靴や段ボールなんかは割と目にするけど、風の強い日なんかは、看板とか余裕であるからね。かつらが落ちてた時は、動物だと思って保護しようと思って車止めたりもしたよね。自動運転車にも不確実性の高い社会ってもんを学んでほしいものだ。

References: Mowing Down Simulated Elephants Could Help Self-Driving Cars Prepare For the Chaos of Real Life Streets / Linkedin

ゾウがいたゾウ

バイクで高速走ってる時

道の真ん中に鉄骨が落ちてた

事あります。幸い踏まなかった。

例題としての「象」は突拍子がないとしても、例えば道路に緊急着陸したセスナ機でも

上から降ってきたビル建築資材だとしても、障害物がなんであっても、

人間が危険だと判断し、回避できることを自動運転システムが同じように安全に回避できなけばダメだよね

だって、道に動物園から脱走した象が歩いていたら人間なら回避できるもん

あるシチュエーションで突然ニンジャが現れて、それを回避できないようであれば、それは十分によい自動運転車とは言えない

比較的よくある現実の問題として、

路面の積雪(車線にはほとんど積もってなく路肩のみの積雪で 路側帯の白線が消えている、路面全体に積雪があり 轍の部分だけ黒い筋が見えているor白く凹んでいる、融雪後のブラック・バーンアウトetc.)をどう判断しているんだろう?

降雪地帯の知人は、「路面に雪があると、ちゃんとした位置を走っていても車線逸脱警報が鳴りっぱなしで、役に立たず邪魔だから切っている」と言っていた。

雪でなく雨でも、広い面積で薄っすら2~3cm程度の水たまりになっているだけなのと、深さ数十cmで水没しているのと、きちんと見分けられるんだろうか?

象が踏んでも大丈夫(^_^)

ふでばこ屋

「ゾウが踏んでも潰れない車を作ればいいのでは?」

想定外は無視して大丈夫だろう運転

可哀想な象

LiDAR非搭載のAIじゃないかこれ?

これって奥行きを認識できてないのでは?

LiDARか複数台のカメラで撮影して奥行きを推定したりしない限り無理でしょ。

人間で言えば片目で運転してるようなもので奥行きがわからなかったら道路の絵は見分けられない。

象とか滑り台は当然人間なら片目でも認識できるけど、これもシステムに奥行き情報があれば何であるかはわからなくても走れないことはわかる。

自動運転が本格化したら、免許を持つのは歩行者の方だね

LiDARくらい非常安全装置として手動運転車にも搭載されてるしな

これは「映像だけでも人間レベルに判断できる性能が無いと不十分だ」という厳しいハードルを課すためのものだと思うよ

そして今まで実際に運転しているのは人間だったんだし、その基準は正当だと思う

でなければ純粋に人間に判断力が負けてるAIがセンサーのゴリ押しで誤魔化してトバしてるってことになるし、それは路上の情報処理において大きな後退だとするべき

人間の代わりになれる水準じゃない。距離情報が無いとゾウも見分けられず全速で突っ込むAIが十分とはお世辞にも言えないよ

「象がいるっ!キット!ジャンプだ!!」

「ハイ、マイケル」

🚗ミ

🐘

人間はLiDAR非搭載でやってのけてるんすよ

LiDAR積めばいいっていう個別の様々な状況に安全対策していくような話は、極論隔離されセンサーが張り巡らされた安全な軌道上を車だけが走ればいいってところまで行き着く

たとえばゾウと同じくらい異常な状況としてはピアノ線のネットが前方に張ってあったとしたら、カメラでは見えてもLiDARは目の荒さ次第で捉えられないしね

人間が視覚聴覚のみで利用しているインフラであるという事実は、逆説的にその視覚聴覚情報だけあれば対応できるということでもある

だから同じ構成で同じ行動をできるようにするという意味で、カメラ+AIという最小構成で完璧動作を目指すことが重要

そのうえでさらにLiDARをつけてより安全にしようってなら意味はある

責任論の面でも最低限「それは避けられたやろ…」ってレベルから「それはしゃーないわ…」って人間に思わせないといけないしね

LiDARは、雨、霧、雪などの悪天候に弱いそうですよ

ゴジラとコング、それにトランスフォーマーも試す必要がある。Uターンして逃走したら合格だ。

で、人間が手動運転する場合と、機械の自動運転の場合と、

道路異常時の運転ミスと、平常時の運転ミスもあわせて考慮した、全体の事故率は、

どっちが高いのかね。